RWKV-4-MusicПЊдДжБСД

ФЃаЭЯТдиЃК

BlinkDL/rwkv-4-music ЁЄ Hugging Face

PythonДњТыЃК

https://github.com/BlinkDL/ChatRWKV/tree/main/music

бЕСЗMIDIЪ§ОнМЏЃК

https://huggingface.co/datasets/breadlicker45/bread-midi-dataset

ФЃаЭСДНгЃК

https://modelscope.cn/models/AI-ModelScope/rwkv-4-world/summary

https://modelscope.cn/models/AI-ModelScope/rwkv-4-music/summary

ДДПеМфЬхбщСДНгЃК

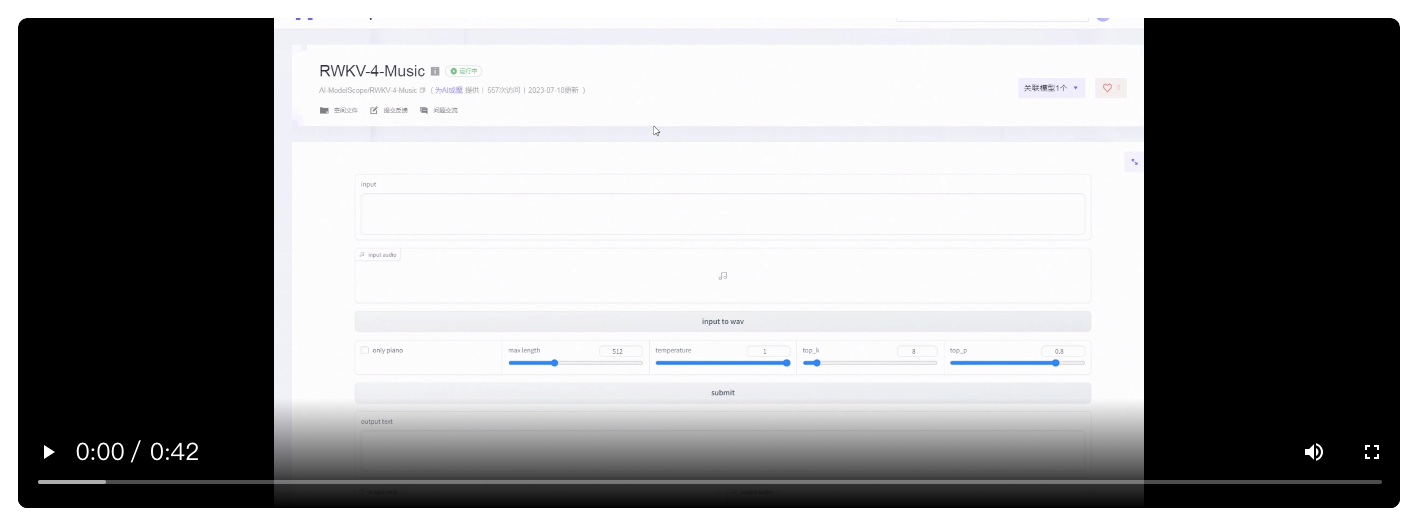

https://modelscope.cn/studios/AI-ModelScope/RWKV-4-Music/summary

https://modelscope.cn/studios/BlinkDL/RWKV-CHN-PRO/summary

RWKV-4-MusicФЃаЭЭЦРэ

ФЃаЭЕФЭЦРэЙ§ГЬЗжЮЊСНВН:

1ЁЂЪЙгУRWKV-4-MusicвєРжЩњГЩФЃаЭ, вдРрЫЦгкЮФБОЩњГЩЕФЗНЪНЩњГЩвЛГЄДЎБрТызХРжЦї, вєЗћ, ЪБГЄЕШаХЯЂЕФзжЗћДЎ, ВЂНЋзжЗћДЎБЃДцШыtxtЮФМўЃЛ

2ЁЂНЋtxtЮФМўзЊЛЛwavЮФМўЃК

- ЪзЯШНЋtxtЮФМўзЊГЩmidiИёЪНЮФМў. midiИёЪНЪЧвЛжжЪ§зжвєРжБъзМ, ЪЧвЛжжЭЈгУЕФвєРжЮФМўИёЪН. midiИёЪНЮФМўВЂВЛАќКЌЩљвєЮФМўБОЩэ, ЖјЪЧАќКЌвЛзщУшЪіШчКЮВЅЗХЩљвєЕФжИСю.

- ЪЙгУmidi2audioЕФpythonАќНЋmidiИёЪНзЊГЩwavИёЪН.

ЕБШЛЭЦРэЕФВНжшПЩФмТдЮЊЗБЫі, ЮвУЧвВЬсЙЉСЫДДПеМфЦНЬЈ, БугкДѓМвНјааФЃаЭЬхбщ:

https://modelscope.cn/studios/AI-ModelScope/RWKV-4-Music/summary

вдЯТЭЦРэЫљашЕФзЪСЯПЩвджБНгДгДДПеМфЕФgitжаЗНБуЕФЛёШЁ. ЛђепФувВПЩвдДгЯТУцЬсЙЉЕФЭјжЗжаНјааЯТди.

ЧызЂвт: вдЯТЕФЭЦРэдЫааашвЊдкlinuxЯЕЭГЛЗОГЯТНјаа.

# АВзАgit, git-lfs. етРяЬсЙЉСНжжЗНЪН sudo apt install git git-lfs # ЪЙгУaptАВзА # conda install git git-lfs -c conda-forge # ЪЙгУcondaАВзА git clone http://www.modelscope.cn/studios/AI-ModelScope/RWKV-4-Music.git

1. ЩњГЩtxtЮФМў

ЪзЯШ, ЮвУЧашвЊзМБИдЫааЕФЛЗОГ

pip install rwkv tqdm mido midi2audio requests certifi -U # АВзАfluidsynthШэМўАќ, дкmidi->wavЕФЪБКђашвЊ. ЮвУЧИјГіСЫСНжжАВзАЗНЪН. sudo apt install fluidsynth # ЪЙгУaptАВзА # conda install fluidsynth -c conda-forge # ЪЙгУcondaАВзА

вдЯТЕФЭЦРэДњТыВЮПМСЫзїепЕФgithubВжПтЃК

https://github.com/BlinkDL/ChatRWKV/blob/main/music/run.py

ЯрЙиАќЕФЕМШы

import os import torch from rwkv.model import RWKV from rwkv.utils import PIPELINE from tqdm import tqdm from modelscope import snapshot_download

ЪЙгУmodelscopeЕФsnapshot_downloadКЏЪ§ЯТдиФЃаЭ, ВЂдиШы.

ЯТдиЕФЮФМўМажаАќКЌ120MКЭ560MЕФФЃаЭ. ЮвУЧЪЙгУ560MЕФФЃаЭ.

model_dir = snapshot_download('AI-ModelScope/rwkv-4-music', revision='v1.0.1') ckpt_120M_fname = "RWKV-4-MIDI-120M-v1-20230714-ctx4096.pth" ckpt_560M_fname = "RWKV-4-MIDI-560M-v1-20230717-ctx4096.pth" ckpt_fpath = os.path.join(model_dir, ckpt_560M_fname) # tokenizer-midi.jsonЮФМўЯТдиТЗОЖ: https://github.com/BlinkDL/ChatRWKV/blob/main/music/tokenizer-midi.json tokenizer_fpath = "tokenizer-midi.json" model = RWKV(model=ckpt_fpath, strategy='cuda fp32') model.eval() pipeline = PIPELINE(model, tokenizer_fpath)

ЖЈвхвЛаЉВЮЪ§

# e.g. # input_text = 'v:5b:3 v:5b:2 t125 t125 t125 t106 pi:43:5 t24 pi:4a:7 t15 pi:4f:7 t17 pi:56:7 t18 pi:54:7 t125 t49 pi:51:7 t117 pi:4d:7 t125 t125 t111 pi:37:7 t14 pi:3e:6 t15 pi:43:6 t12 pi:4a:7 t17 pi:48:7 t125 t60 pi:45:7 t121 pi:41:7 t125 t117 s:46:5 s:52:5 f:46:5 f:52:5 t121 s:45:5 s:46:0 s:51:5 s:52:0 f:45:5 f:46:0 f:51:5 f:52:0 t121 s:41:5 s:45:0 s:4d:5 s:51:0 f:41:5 f:45:0 f:4d:5 f:51:0 t102 pi:37:0 pi:3e:0 pi:41:0 pi:43:0 pi:45:0 pi:48:0 pi:4a:0 pi:4d:0 pi:4f:0 pi:51:0 pi:54:0 pi:56:0 t19 s:3e:5 s:41:0 s:4a:5 s:4d:0 f:3e:5 f:41:0 f:4a:5 f:4d:0 t121 v:3a:5 t121 v:39:7 t15 v:3a:0 t106 v:35:8 t10 v:39:0 t111 v:30:8 v:35:0 t125 t117 v:32:8 t10 v:30:0 t125 t125 t103 v:5b:0 v:5b:0 t9 pi:4a:7' input_text = '' only_piano = False max_length = 512 max_length = min(max_length, 4096) temperature = 1 top_k = 8 top_p = 0.8 # txt_fpath = 'midi.txt' midi_fpath = 'midi_bin.midi' wav_fpath = 'wav_bin.wav'

НјааФЃаЭЕФЭЦРэКЭЮФБОЩњГЩ

input_text = input_text.strip() input_text = f'<pad> {input_text}' output_text = '<start>' # occurrence = {} state = None for i in tqdm(range(max_length)): if i == 0: out, state = model.forward(pipeline.encode(input_text), state) else: out, state = model.forward([token], state) # for n in occurrence: out[n] -= (0 + occurrence[n] * 0.5) out[0] += (i - 2000) / 500 # try not to be too short or too long out[127] -= 1 # avoid "t125" # if only_piano: out[128:12416] -= 1e10 out[13952:20096] -= 1e10 # find the best sampling for your taste token = pipeline.sample_logits( out, temperature=temperature, top_k=top_k, top_p=top_p) if token == 0: break for n in occurrence: occurrence[n] *= 0.997 # decay repetition penalty if token >= 128 or token == 127: occurrence[token] = 1 + \ (occurrence[token] if token in occurrence else 0) else: occurrence[token] = 0.3 + \ (occurrence[token] if token in occurrence else 0) output_text += f" {pipeline.decode([token])}" output_text += ' <end>'

НЋЩњГЩЕФЮФБОаДШыtxtЮФМў

with open(txt_fpath, "w") as f: f.write(output_text)

2. txtЮФМў -> wavЮФМў

ЕБШЛвдЯТЕФВНжшПЩФмБШНЯЗБЫі, ЮвУЧвВПЩвдЪЙгУДДПеМфЬсЙЉЕФtxt -> wavЕФЙІФмЗНБуЕФНјааИёЪНзЊЛЛ.

https://modelscope.cn/studios/AI-ModelScope/RWKV-4-Music/summary

txtЮФМў -> midiЮФМў

# midi_utilЮФМўЯТди: https://github.com/briansemrau/MIDI-LLM-tokenizer/blob/main/midi_util.py # vocab_configЮФМўЯТди: https://github.com/briansemrau/MIDI-LLM-tokenizer/blob/main/vocab_config.json import midi_util from midi_util import VocabConfig def txt_to_midi(text_fpath: str, output_fpath: str): vocab_config = "vocab_config.json" cfg = VocabConfig.from_json(vocab_config) with open(text_fpath, "r") as f: text = f.read() text = text.strip() mid = midi_util.convert_str_to_midi(cfg, text) mid.save(output_fpath) txt_to_midi(txt_fpath, midi_fpath)

midiЮФМў -> wavЮФМў

# етРяЕФ.sf2ЮФМўЯТдиТЗОЖ: https://github.com/vyshor/MusicAids/blob/master/default_sound_font.sf2 from midi2audio import FluidSynth def midi_to_wav(midi_path: str, wav_path: str) -> None: # ЩшжУвєдДЃЌФуашвЊЯТдивЛИі.sf2ЮФМўЃЌетЪЧвЛИівєдДЮФМў fs = FluidSynth('default_sound_font.sf2') fs.midi_to_audio(midi_path, wav_path) midi_to_wav(midi_fpath, wav_fpath)

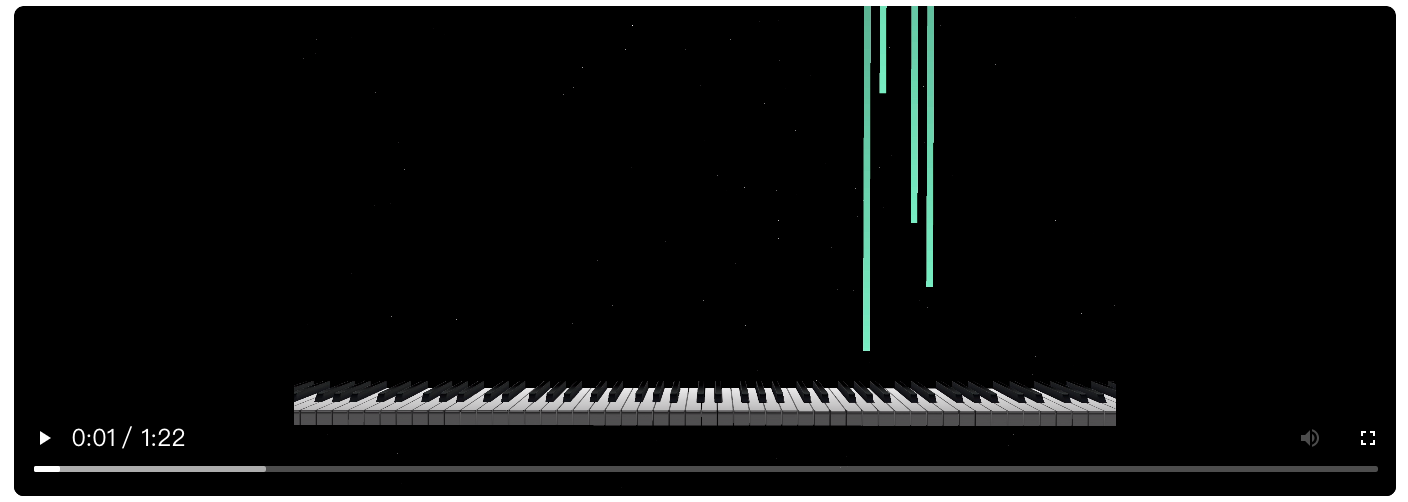

ШЛКѓЮвУЧОЭЛёЕУСЫwav_bin.wavЕФвєЦЕЮФМў, Ь§вЛЯТЮвУЧВњЩњЕФвєЦЕРВЃЁЃЁЃЁ

аЇЙћеЙЪО

ЮвУЧТМжЦСЫвЛЖЮФЇДюДДПеМфЕФДДзїаЇЙћЃЌРДИаЪмвЛЯТAIзїЧњЕФДДзїФмСІАШЃЁ

ЃЈФЇДюДДПеМфВйзїжИв§ЃЌЯТЗНдФЖСдЮФПЩжБДяЃЉ

https://modelscope.cn/studios/AI-ModelScope/RWKV-4-Music/summary

дЪМinputЧњЦзЃК

ФЇДюДДПеМфЭЦМі2зщВЮЪ§ЩњГЩЧњЦзаЇЙћЃЌПДПДДѓМвЯВЛЖФФзщФиЃК

only piano:trueЃЌmax length:512ЃЌtemperature:1ЃЌtop_k:8ЃЌtop_p:0.8

01:03

only piano:falseЃЌmax length:512ЃЌtemperature:1ЃЌtop_k:10ЃЌtop_p:0.8