вЛЃЌЛиЙщЗжЮіИХЪі

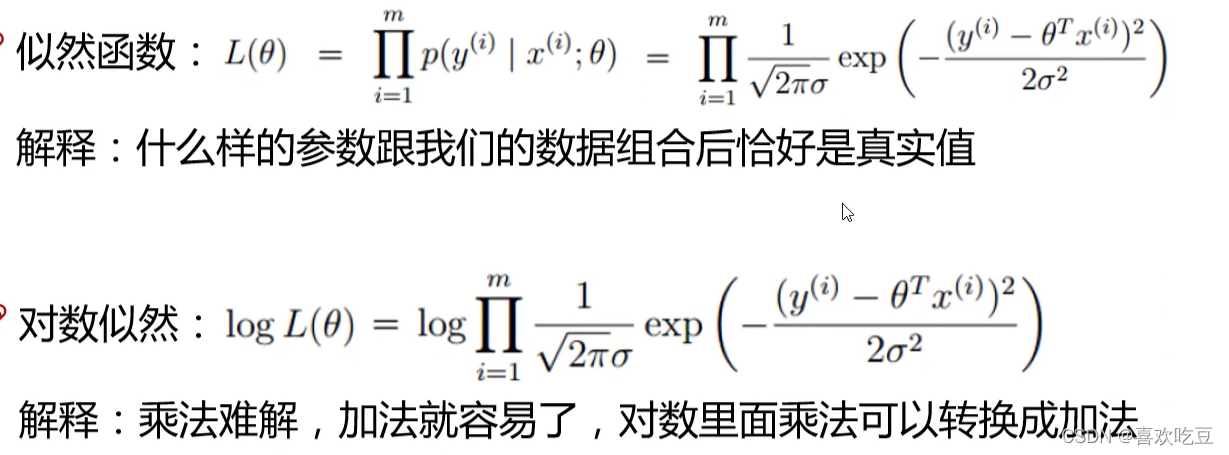

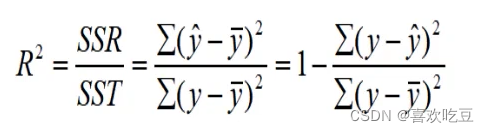

ВаВю==ЮѓВюЯю

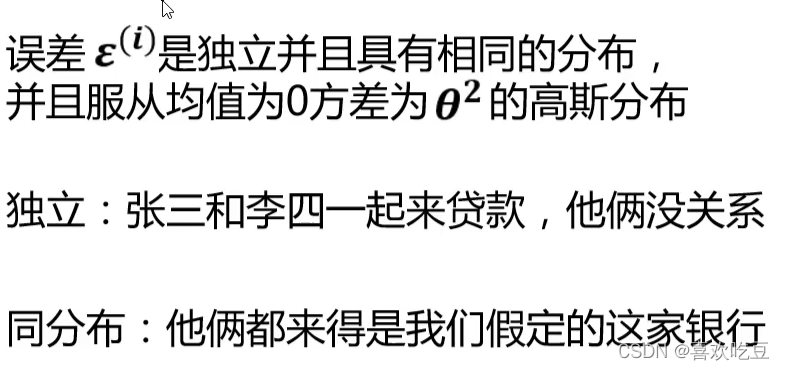

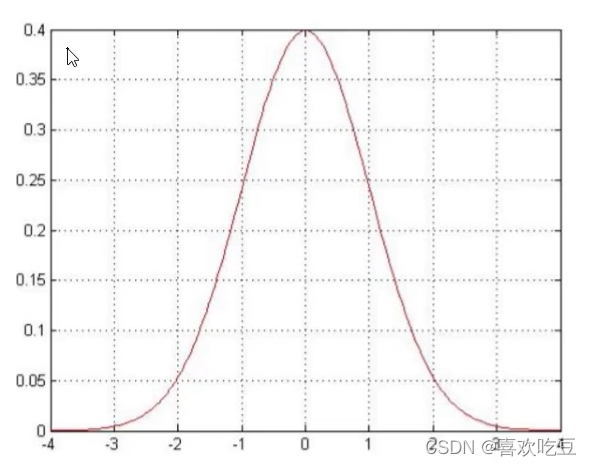

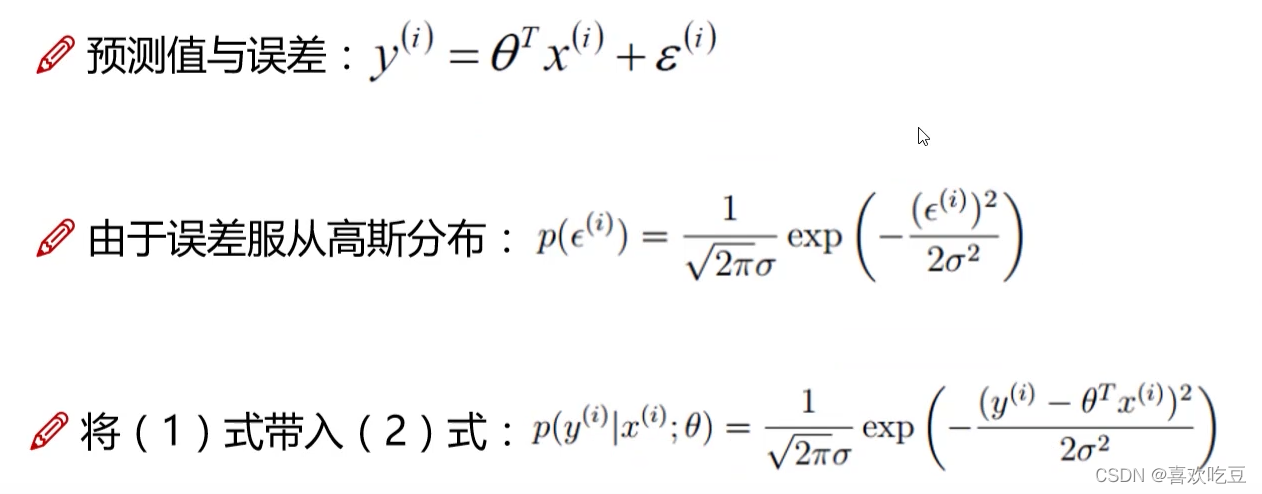

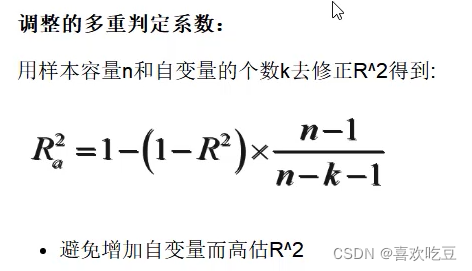

ЯрЙиЗжЮіЪЧбаОПСНИіЛђСНИівдЩЯЕФБфСПжЎМфЯрЙиГЬЖШМАДѓаЁЕФвЛжжЭГМЦЗНЗЈ

ЛиЙщЗжЮіЪЧбАевДцдкЯрЙиЙиЯЕЕФБфСПМфЕФЪ§бЇБэДяЪНЃЌВЂНјааЭГМЦЭЦЖЯЕФвЛжжЭГМЦЗНЗЈ

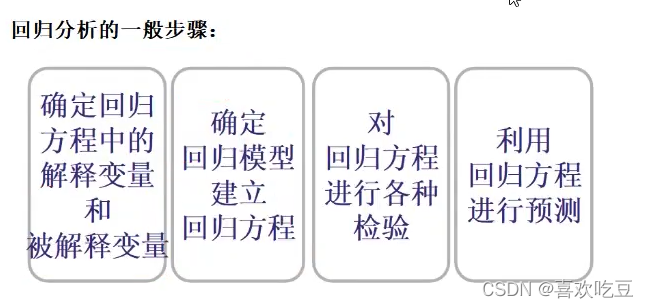

дкЖдЛиЙщЗжЮіНјааЗжРрЪБЃЌжївЊгаСНжжЗжРрЗНЪН:

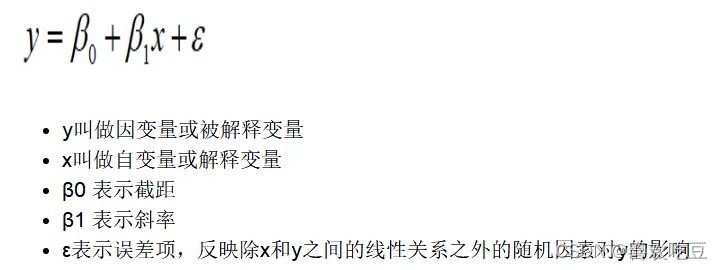

ЁёИљОнБфСПЕФЪ§ФПЃЌПЩвдЗжРрвЛдЊЛиЙщЁЂЖрдЊЛиЙщ

ЁёИљОнздБфСПгывђБфСПЕФБэЯжаЮЪНЃЌЗжЮЊЯпадгыЗЧЯпад

ЫљвдЃЌЛиЙщЗжЮіАќРЈЫФИіЗНЯђ:вЛ дЊЯпадЛиЙщЗжЮіЁЂЖрдЊЯпадЛиЙщЗжЮіЁЂвЛдЊЗЧЯпадЛиЙщЗжЮіЁЂЖрдЊЗЧЯпадЛиЙщЗжЮіЁЃ

ЖўЃЌвЛдЊЯпадЛиЙщЗжЮі

ЁёвђБфСП(dependent variable): БЛдЄВтЛђБЛНтЪЭЕФБфСПЃЌгУyБэЪО

ЁёздБфСП(independent variable):дЄВтЛђНтЪЭвђБфСПЕФвЛвЛИіЛђЖрИіБфСПЃЌгУxБэЪО

ЁёЖдгкОпгаЯпадЙиЯЕЕФСНИіБфСПЃЌПЩвдгУвЛИіЗНГЬРДБэЪОЫќУЧжЎМфЕФЯпадЙиЯЕ

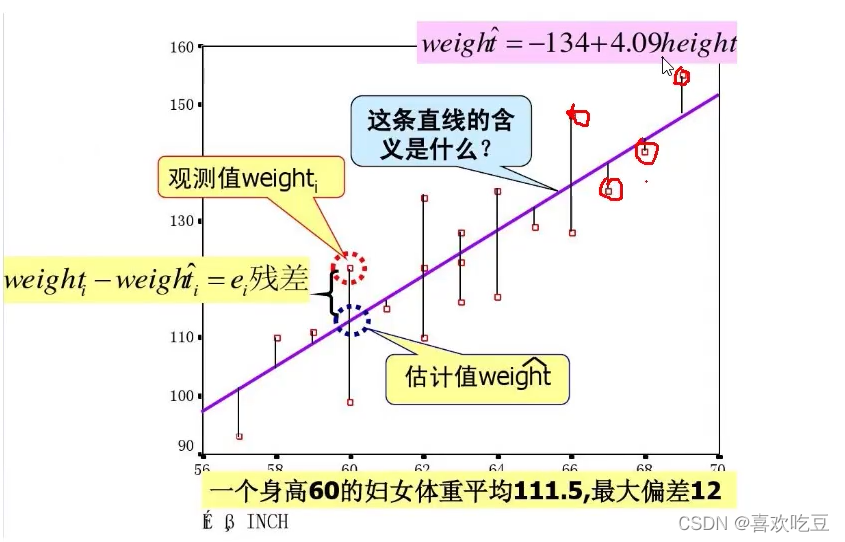

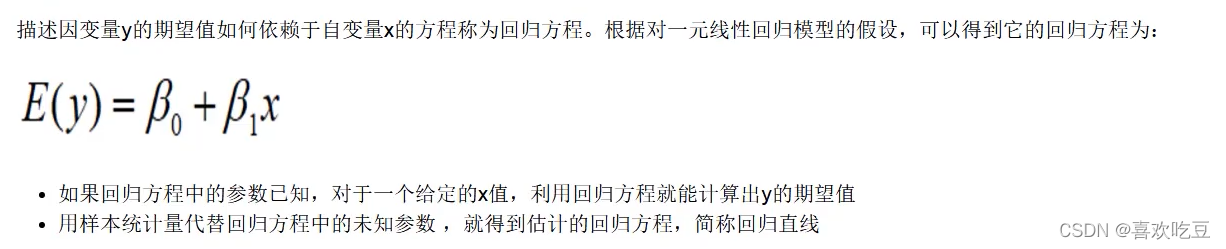

ЁёУшЪівђБфСПyШчКЮвРРЕгкздБфСПxКЭЮѓВюЯю8ЕФЗНГЬГЦЮЊЛиЙщФЃаЭЁЃЖдгкжЛЩцМАвЛИіздБфСПЕФвЛдЊЯпадЛиЙщФЃаЭПЩБэЪОЮЊ:

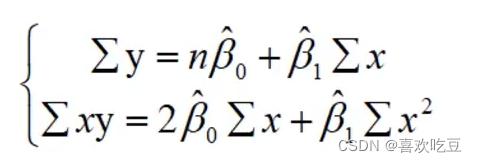

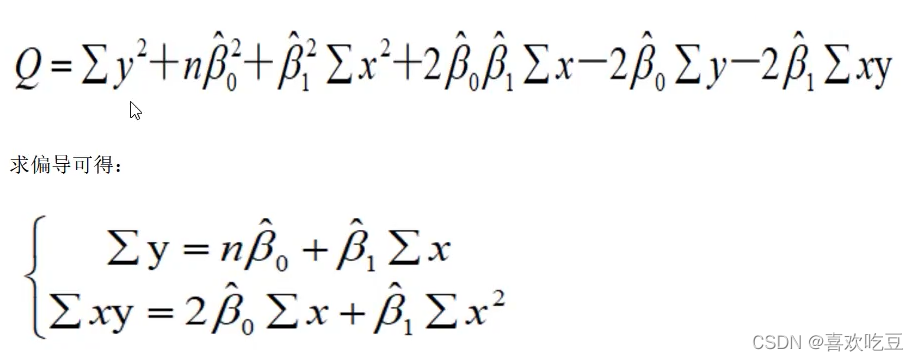

ЛиЙщЗНГЬЃК

Ш§ЃЌЮѓВю

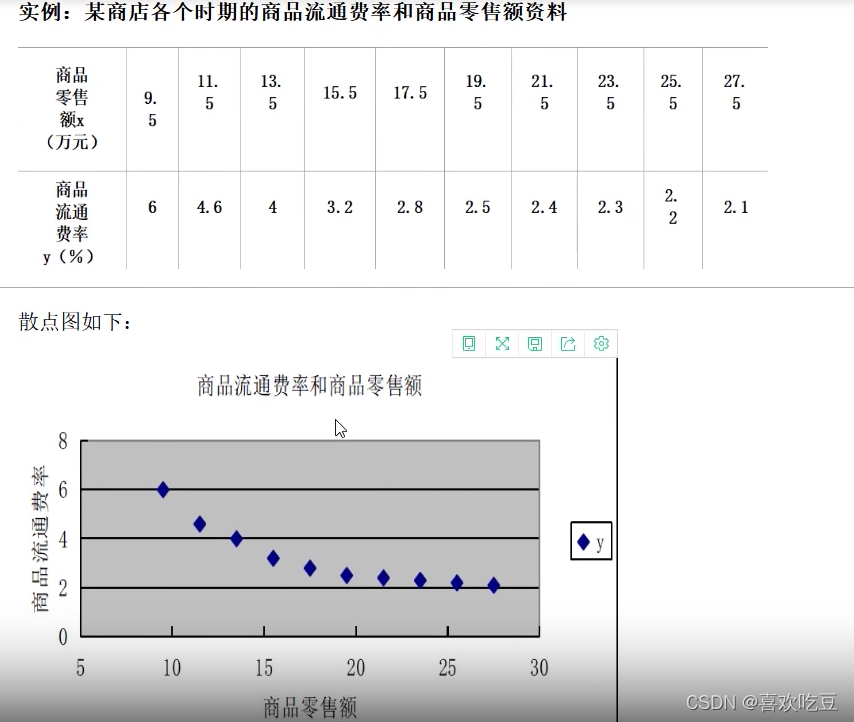

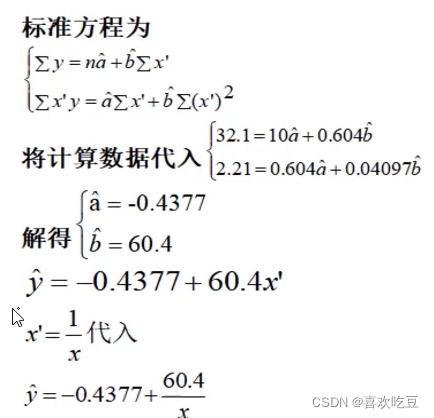

ИпЫЙЗжВМ:вјааПЩФмЛсЖрИј,вВПЩФмЛсЩйИј,ЕЋЪЧОјДѓЖрЪ§ЧщПіЯТетИіИЁЖЏВЛЛсЬЋДѓ,МЋаЁЧщПіЯТИЁЖЏЛсБШНЯДѓ,ЗћКЯе§ГЃЧщПі

ЫФЃЌзюаЁЖўГЫЗЈЕФЭЦЕМКЭЧѓНт

зюаЁЖўГЫЗЈЭЦЕМЃК

РћгУЛиЙщжБЯпНјааЙРМЦгыдЄВтЃК

ЕуЙРМЦ:РћгУЙРМЦЕФЛиЙщЗНГЬЃЌЖдгкxЕФФГвЛИіЬиЖЈЕФжЕЃЌЧѓГіyЕФвЛИіЙРМЦжЕОЭЪЧЕуЙРМЦ

ЧјМфЙРМЦ:РћгУЙРМЦЕФЛиЙщЗНГЬЃЌЖдгкxЕФвЛИіЬиЖЈжЕЃЌЧѓГіyЕФвЛИіЙРМЦжЕЕФЧјМфОЭЪЧЧјМфЙРМЦ

ЙРМЦБъзМВюЃК

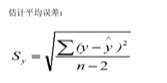

ЮЊСЫЖШСПЛиЙщЗНГЬЕФПЩППадЃЌЭЈГЃМЦЫуЙРМЦБъзМЮѓВюЁЃЫќЖШСПЙлВьжЕЛиШЦзХЛиЙщжБЯпЕФБфЛЏГЬЖШЛђЗжЩЂГЬЖШЁЃ

ЁёЙЋЪНжаИљКХФкЕФЗжФИЪЧn-2,ЖјВЛЪЧnЃЌвђЖјздгЩЖШЮЊn-2ЁЃ

ЁёЙРМЦБъзМЮѓВюдНДѓЃЌдђЪ§ОнЕуЮЇШЦЛиЙщжБЯпЕФЗжЩЂГЬЖШОЭдНДѓЃЌЛиЙщЗНГЬЕФДњБэаддНаЁЁЃ

ЁёЙРМЦБъзМЮѓВюдНаЁЃЌдђЪ§ОнЕуЮЇШЦЛиЙщжБЯпЕФЗжЩЂГЬЖШдНаЁЃЌЛиЙщЗНГЬЕФДњБэгњДѓЃЌЦфПЩППаддНИпЁЃ

здгЩЖШОЭЪЧвЛИіЯЕЭГдкВЛЮЅЗДШЮКЮЯожЦЬѕМўЯТЃЌПЩвдздгЩБфЛЏЕФЮЌЖШЁЃ

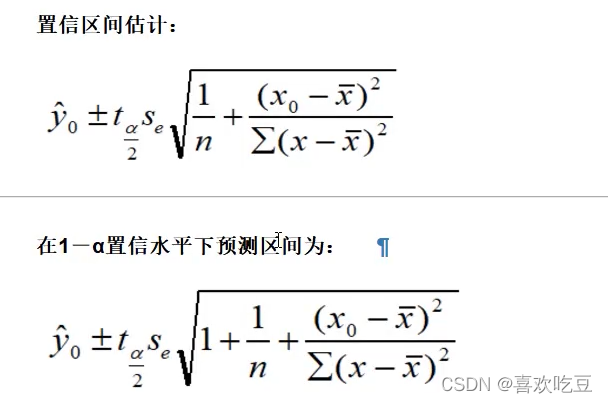

гАЯьЧјМфПэЖШЕФвђЫи:

ЁёжУаХЫЎЦН(1 -a)ЃЌЧјМфПэЖШЫцжУаХЫЎЦНЕФдіДѓЖјдіДѓ

ЁёЪ§ОнЕФРыЩЂГЬЖШSeЃЌЧјМфПэЖШЫцРыГЬЖШЕФдіДѓЖјдіДѓбљБОШнСПЃЌЧјМфПэЖШЫцбљБОШнСПЕФдіДѓЖјМѕаЁ

ЁёX0гыXОљжЕжЎМфЕФВювьЃЌЫцзХВювьГЬЖШЕФдіДѓЖјдіДѓ

ЮхЃЌЛиЙщжБЯпЕФФтКЯгХЖШ

ЛиЙщжБЯпгыИїЙлВтЕуЕФНгНќГЬЖШГЦЮЊЛиЙщжБЯпЖдЪ§ОнЕФФтКЯгХЖШ

змЦНЗНКЭПЩвдЗжНтЮЊЛиЙщЦНЗНКЭЁЂВаВюЦНЗНКЭСНВПЗж: SST= SSR+SSE

ЁёзмЦНЗНКЭ(SST)ЃЌЗДгГвђБфСПЕФnИіЙлВьжЕгыЦфОљжЕЕФзмРыВю

ЁёЛиЙщЦНЗНКЭSSRЗДгГСЫyЕФзмБфВюжаЃЌгЩгкxгыyжЎМфЕФЯпадЙиЯЕв§Ц№ЕФyЕФБфЛЏВПЗж

ЁёВаВюЦНЗНКЭSSEЗДгГСЫГ§СЫxЖдyЕФЯпадгАЯьжЎЭтЕФЦфЫћвђЫиЖдyБфВюЕФзїгУЃЌЪЧВЛФмгЩЛиЙщжБЯпРДНтЪЭЕФyЕФБфВюВПЗж

ХаЖЈЯЕЪ§ЃК

ЛиЙщЦНЗНКЭеМзмЦНЗНКЭЕФБШР§ЃЌгУR^2БэЪОЃЌЦфжЕдк0ЕН1жЎМфЁЃ

ЁёR^2== 0: ЫЕУїyЕФБфЛЏгыxЮоЙиЃЌxЭъШЋЮожњгкНтЪЭyЕФБфВю

ЁёR^2== 1:ЫЕУїВаВюЦНЗНКЭЮЊ0ЃЌФтКЯЪЧЭъШЋЕФЃЌyЕФБфЛЏжЛгыxгаЙи

СљЃЌЯджјадМьбщЃК

ЯджјадМьбщЕФжївЊФПЕФЪЧИљОнЫљНЈСЂЕФЙРМЦЗНГЬгУздБфСПxРДЙРМЦЛђдЄВтвђБфСПyЕФШЁжЕЁЃЕБНЈСЂСЫЙРМЦЗНГЬКѓЃЌЛЙВЛФмТэЩЯНјааЙРМЦЛђдЄВтЃЌвђЮЊИУЙРМЦЗНГЬЪЧИљОнбљБОЪ§ОнЕУЕНЕФЃЌЫќЪЧЗёецЪЕЕФЗДгГСЫБфСПxКЭyжЎМфЕФЙиЯЕЃЌдђашвЊЭЈЙ§МьбщКѓВХФмжЄЪЕЁЃ

ИљОнбљБОЪ§ОнФтКЯЛиЙщЗНГЬЪБЃЌЪЕМЪЩЯОЭвбОМйЖЈБфСПxгыyжЎМфДцдкзХЯпадЙиЯЕЃЌВЂМйЖЈЮѓВюЯюЪЧвЛИіЗўДге§ЬЌЗжВМЕФЫцЛњБфСПЃЌЧвОпгаЯрЭЌЕФЗНВюЁЃЕЋетаЉМйЩшЪЧЗёГЩСЂашвЊМьбщ

1ЃЌЯджјадМьбщАќРЈСНЗНУц:

1ЃЉЯпадЙиЯЕМьбщ

ЯпадЙиЯЕМьбщЪЧМьбщздБфСПxКЭвђБфСПyжЎМфЕФЯпадЙиЯЕЪЧЗёЯджјЃЌЛђепЫЕЃЌЫќУЧжЎМфФмЗёгУвЛИіЯпадФЃаЭРДБэЪОЁЃ

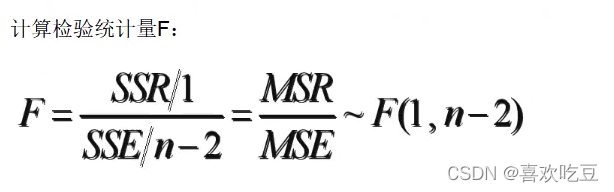

НЋОљЗНЛиЙщ(MSR)ЭЌОљЗНВаВю(MSE)МгвдБШНЯЃЌгІгУFМьбщРДЗжЮіЖўепжЎМфЕФВюБ№ЪЧЗёЯджјЁЃ

ЁёОљЗНЛиЙщ:ЛиЙщЦНЗНКЭSSRГ§вдЯргІЕФздгЩЖШ(здБфСПЕФИіЪ§K)

ЁёОљЗНВаВю:ВаВюЦНЗНКЭSSEГ§вдЯргІЕФздгЩЖШ(n-k-1)

H0: ІТ1=0 ЫљгаЛиЙщЯЕЪ§гыСуЮоЯджјВювьЃЌyгыШЋЬхxЕФЯпадЙиЯЕВЛЯджј

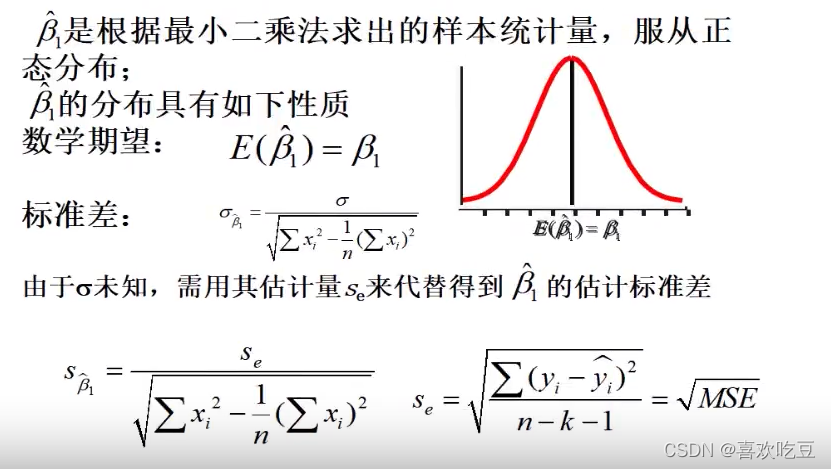

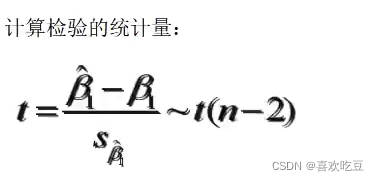

2ЃЉЛиЙщЯЕЪ§Мьбщ

ЛиЙщЯЕЪ§ЯджјадМьбщЕФФПЕФЪЧЭЈЙ§МьбщЛиЙщЯЕЪ§ІТЕФжЕгы0ЪЧЗёгаЯджјадВювьЃЌРДХаЖЯYгыXжЎМфЪЧЗёгаЯджјЕФЯпадЙиЯЕ.ШєB=0,дђзмЬхЛиЙщЗНГЬжаВЛКЌXЯю(МДYВЛЫцXБфЖЏЖјБфЖЏ),вђДЫ,БфСПYгыXжЎМфВЂВЛДцдкЯпадЙиЯЕ;ШєІТЁй0,ЫЕУїБфСПYгыXжЎМфДцдкЯджјЕФЯпадЙиЯЕЁЃ

2ЃЌЯпадЙиЯЕМьбщгыЛиЙщЯЕЪ§МьбщЕФЧјБ№:

ЯпадЙиЯЕЕФМьбщЪЧМьбщздБфСПгывђБфСПЪЧЗёПЩвдгУЯпадРДБэДяЃЌЖјЛиЙщЯЕЪ§ЕФМьбщЪЧЖдбљБОЪ§ОнМЦЫуЕФЛиЙщЯЕЪ§МьбщзмЬхжаЛиЙщЯЕЪ§ЪЧЗёЮЊ0

ЁёдквЛдЊЯпадЛиЙщжаЃЌздБфСПжЛгавЛИіЃЌЯпадЙиЯЕМьбщгыЛиЙщЯЕЪ§МьбщЪЧЕШМлЕФ

ЁёЖрдЊЛиЙщЗжЮіжаЃЌетСНжжМьбщЕФвтвхЪЧВЛЭЌЕФЁЃЯпадЙиЯЕМьбщжЛФмгУРДМьбщзмЬхЛиЙщЙиЯЕЕФЯджјадЃЌЖјЛиЙщЯЕЪ§МьбщПЩвдЖдИїИіЛиЙщЯЕЪ§ЗжБ№НјааМьбщ

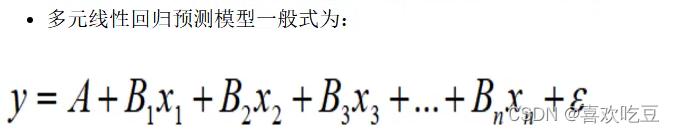

ЦпЃЌЖрдЊЯпадЛиЙщ

ОГЃЛсгіЕНФГвЛЯжЯѓЕФЗЂеЙКЭБфЛЏШЁОігкМИИігАЯьвђЫиЕФЧщПіЃЌвВОЭЪЧвЛИівђБфСПКЭМИИіздБфСПгавРДцЙиЯЕЕФЧщПіЃЌетЪБашгУЖрдЊЯпадЛиЙщЗжЮіЁЃ

ЖрдЊЯпадЛиЙщЗжЮідЄВтЗЈЃЌЪЧжИЭЈЙ§ЖдСНЩЯЛђСНИівдЩЯЕФздБфСПгывЛИівђБфСПЕФЯрЙиЗжЮіЃЌНЈСЂдЄВтФЃаЭНјаадЄВтКЭПижЦЕФЗНЗЈ

АЫЃЌЧњЯпЛиЙщЗжЮі

жБЯпЙиЯЕЪЧСНБфСПМфзюМђЕЅЕФвЛжжЙиЯЕЃЌЧњЯпЛиЙщЗжЮіЕФЛљБОШЮЮёЪЧЭЈЙ§СНИіЯрЙиБфСПxгыyЕФЪЕМЪЙлВтЪ§ОнНЈСЂЧњЯпЛиЙщЗНГЬЃЌвдНвЪОxгыyМфЕФЧњЯпСЊЯЕЕФаЮЪНЁЃ

ЧњЯпЛиЙщЗжЮізюРЇФбКЭЪзвЊЕФЙЄзїЪЧШЗЖЈздБфСПгывђБфСПМфЕФЧњЯпЙиЯЕЕФРраЭЃЌЧњЯпЛиЙщЗжЮіЕФЛљБОЙ§ГЬ:

1ЃЉЯШНЋxЛђyНјааБфСПзЊЛЛ

2ЃЉЖдаТБфСПНјаажБЯпЛиЙщЗжЮіЁЂНЈСЂжБЯпЛиЙщЗНГЬВЂНјааЯджјадМьбщКЭЧјМфЙРМЦ

3ЃЉНЋаТБфСПЛЙдЮЊдБфСПЃЌгЩаТБфСПЕФжБЯпЛиЙщЗНГЬКЭжУаХЧјМфЕУГідБфСПЕФЧњЯпЛиЙщЗНГЬКЭжУаХЧјМф.

гЩгкЧњЯпЛиЙщФЃаЭжжРрЗБЖрЃЌЫљвдУЛгаЭЈгУЕФЛиЙщЗНГЬПЩжБНгЪЙгУЁЃЕЋЪЧЖдгкФГаЉЬиЪтЕФЛиЙщФЃаЭЃЌПЩвдЭЈЙ§БфСПДњЛЛЁЂШЁЖдЪ§ЕШЗНЗЈНЋЦфЯпадЛЏЃЌШЛКѓЪЙгУБъзМЗНГЬЧѓНтВЮЪ§ЃЌдйНЋВЮЪ§ДјЛидЗНГЬОЭЪЧЫљЧѓЁЃ

Р§згЃК

ОХЃЌЖржиЙВЯпад

ЛиЙщФЃаЭжаСНИіЛђСНИівдЩЯЕФздБфСПБЫДЫЯрЙиЕФЯжЯѓ

1ЃЌЖржиЙВЯпадДјРДЕФЮЪЬтга:

1ЃЉЛиЙщЯЕЪ§ЙРМЦжЕЕФВЛЮШЖЈаддіЧП

2ЃЉЛиЙщЯЕЪ§МйЩшМьбщЕФНсЙћВЛЯджјЕШ

2ЃЌЖржиЙВЯпадМьбщЕФжївЊЗНЗЈ:

1ЃЉШнШЬЖШ

2ЃЉЗНВюХђеЭвђзг(VIF)

3ЃЌШнШЬЖШ

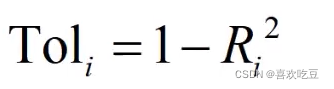

ЁёRiЪЧНтЪЭБфСПxiгыЗНГЬжаЦфЫћНтЪЭБфСПМфЕФИДЯрЙиЯЕЪ§;

ЁёШнШЬЖШдк0~1жЎМфЃЌдННгНќгк0ЃЌБэЪОЖржиЙВЯпаддНЧПЃЌдННгНќгк1ЃЌБэЪОЖржиЙВЯпаддНШѕЁЃ

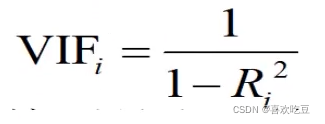

4ЃЌЗНВюХђеЭвђзг

ЗНВюХђеЭвђзгЪЧШнШЬЖШЕФЕЙЪ§

ЁёVIFiдНДѓЃЌЬиБ№ЪЧДѓгкЕШгк10ЃЌЫЕУїНтЪЭБфСПxiгыЗНГЬжаЦфЫћНтЪЭБфСПжЎМфгабЯжиЕФЖржиЙВЯпад;

ЁёVIFiдННгНќ1ЃЌБэУїНтЪЭБфСПxiКЭЦфЫћНтЪЭБфСПжЎМфЕФЖржиЙВЯпаддНШѕЁЃ