ЧАЖЫЙЄГЬЪІУЧПкРяЕФwebгявхЛЏЃЌЪЕМЪЩЯЪЧжИHTML5БъЧЉЕФгявхЛЏЁЃ

ЕЋЪЧетВЂВЛЭъШЋе§ШЗЃЌдкW3CБъзМЃЌгаsemantic webЕФЯъЯИНщЩмЃЌЮвНЋНсКЯW3CБъзМЕФНщЩмКЭЦфЫћзЪСЯЃЌЩюШыРэНтwebгявхЛЏЃЌЖјВЛНіНіЭЃСєдкБъЧЉВуУцЁЃ

ФЧУДHTMLЕФгявхЛЏОЭВЛживЊСЫТ№ЃПЯдШЛВЛЪЧЃЌmediumЩЯгавЛЦЊКмКУЕФВЉПЭЁЃ

- гявхбЇгыМЦЫуЛњПЦбЇЕФЙиЯЕЪЧЪВУДЃП

- semantic webЪЧЪВУДЃП

- ЭЈЙ§TypeScriptРэНтЮЊЪВУДSemantic HTMLКмживЊЃП

- Г§СЫдіЧППЩЖСадЃЌSemantic HTMLЛЙгаФФаЉЗНУцКмживЊЃП

- HTMLгявхЛЏБъЧЉВЮПМЪжВс

- НјвЛВНдіЧПWebгявхЛЏЕФWAI-ARIA

гявхбЇгыМЦЫуЛњПЦбЇЕФЙиЯЕЪЧЪВУД

вдЯТФкШнеЊздЮЌЛљАйПЦЃК

вЛИіТпМЯЕЭГЭЈГЃгЩШ§ИіВПЗжзщГЩЃЌМД ДЪЛуВПЗжЁЂ ОфЗЈВПЗжКЭЛљгкФЃаЭТлЕФ гявхВПЗжЁЃЫљЮНЕФДЪЛуВПЗжОЭЪЧСаОйГівЛИіаЮЪНЯЕЭГЫљЪЙгУЕФЫљгаЗћКХЃЌОфЗЈВПЗжЪЧетаЉЗћКХЕФзщКЯЙцдђЃЌЙцЖЈЪВУДбљЕФЗћКХађСаПЩвдЪЧетИіЯЕЭГЕФОфзгЃЌгявхВПЗжЪЧЖдКЯИёОфзгЕФНтЪЭЃЌетбљЕФНтЪЭЭЈГЃЪЧЃКдквЛИіФЃаЭжаНјааЕФЖдецжЕЬѕМўЭЦЕМЁЃТпМбЇЕФгявхбЇзХблЕудкгкТпМЯЕЭГЕФгявхНтЪЭЃЌЪЧвЛИіРэЯыЛЏЕФФЃаЭЯЕЭГЃЌВЛжБНгЩцМАздШЛгябдЁЃЛЅСЊЭјРэТлжаЬжТлЕФWeb 2.0ЕФвЛИіКмживЊЕФЬиеїОЭЪЧгявхЭјТчЃЌЦфФПЕФЪЧвдгявхЮЊИйСьзщжЏЭјТчзЪдД

semantic webЪЧЪВУДЃП

Г§СЫОЕфЕФ"Web of documents" W3CвВжТСІгкЙЙНЈвЛИіММЪѕеЛШЅжЇГж"Web of data"ЃЌвВОЭЪЧЪ§ОнПтжаФуЕФЪ§ОнЕФЫГађЁЃWeb of dataЕФжеМЋФПЕФдкгкЃКШУМЦЫуЛњзіИќЖрЕФгагУЕФЙЄзїШЅПЊЗЂЯЕЭГЃЌДгЖјЭЈЙ§ЭјТчШЅжЇГжПЩвдаХРЕЕФНЛЛЅЁЃW3CЪѕгя"Semantic Web"жИЕФЪЧЖдWebСДНгЕФЪ§ОнЁЃгявхWebММЪѕЪЙШЫУЧПЩвддкWebЩЯДДНЈЪ§ОнВжПтЃЌНЈСЂДЪЛуБэЃЌЮЊашвЊДІРэЕФЪ§ОнаДЙцдђЁЃLinked data гЩРрЫЦRDFЃЌSPARQLЃЌOWLКЭSKOSЁЃ

Linked Data

Semantic WebЪЧНЈСЂдкЪ§ОнЩЯЕФWebЃЌАќРЈШеЦкЃЌБъЬтКЭВПЗжЪ§зжвдМАЛњжЦЪєадвдМАШЮКЮЦфЫћЕФПЩвдЯыЯѓЕНЕФЪ§ОнЁЃRDFЬсЙЉСЫЗЂВМКЭСДНгЪ§ОнЕФЛљДЁЁЃЖржжММЪѕдЪаэФудкЮФЕЕжаЧЖШыЪ§ОнЃЈRDFaЃЌGRDDLЃЉЛђепБЉТЖSQLЪ§ОнПтРяЕФЪ§ОнЃЌЛђепЭЈЙ§RDFЮФМўЧЖШыЁЃ

Vocabulary

гаЪБКђзщжЏЪ§ОнИќживЊИќгаМлжЕЁЃЪЙгУOWLЃЈЙЙНЈДЪЛуЛђепБОЬхЃЉвдМАSKOSЃЈЩшМЦжЊЪЖзщжЏЯЕЭГЃЉЃЌЭЈЙ§ИНЪєЕФвтвхenrichЪ§ОнЃЌетОЭПЩвддЪаэИќЖрЕФШЫЛђепИќЖрЕФЛњЦїЛљгкЪ§ОнзіИќЖрЕФЪТЁЃ

Query

ВщбЏгябдгыЪ§ОнПтЯЂЯЂЯрЙиЁЃШчЙћSemantic WebБЛЕБзівЛИіШЋОжЕФЪ§ОнПтЃЌФЧУДРэНтЮЊЪВУДашвЊвЛУХгябдгУРДВщбЏЪ§ОнОЭКмЧсЫЩСЫЁЃSPARQLОЭЪЧSemantic WebЕФВщбЏгябдЁЃ

Inference

дкSemantic WebеЛЖЅЃЌПЩвдевЕНв§гУ--ЭЈЙ§ЙцдђЭЦРэЪ§ОнЁЃW3CЛљгкЙцдђЙЄзїЃЌжївЊЭЈЙ§RIFКЭOWLЃЌМЏжаОЋСІдкВЛЭЌЯЕЭГжЎМфЕФЙцдђгябдКЭНЛЛЛЙцдђЁЃ

Vertical Application

W3CЙЄзїдкВЛЭЌЕФВњвЕЃЌР§ШчдквНСЦНЁПЕКЭЩњУќПЦбЇЃЌЕчзгеўЮёЃЌЬсЩ§КЯзїФмСІЕФФмСІЃЌбаОПКЭПЊЗЂЃЌвдМАЭЈЙ§гявхЛЏЕФWebДДаТИяаТЕФММЪѕИФИяЁЃР§ШчЃЌЭЈЙ§АяжњСйДВбаОПжаЕФОіВпЃЌгявхWebММЪѕНЋПчЛњЙЙЧХНгЖржжаЮЪНЕФЩњЮяКЭвНбЇаХЯЂЁЃ

ЭЈЙ§TypeScriptРэНтЮЊЪВУДSemantic HTMLКмживЊЃП

дЮФСДНгЃКUnderstanding why Semantic HTML is important, as told by TypeScript.

ЮЊСЫПижЦЪБМфГЩБОЃЌЮвНЋжЛМЧТМздМКШЯЮЊживЊЕФжЊЪЖЕуЃЌЖјВЛЪЧЭЈЦЊЗвыСЫЁЃ

- ЕБНёгавЛжжаћбяJavaScriptЃЌБсЕЭHTMLЕФЧїЪЦЃЌетЪЧВЛе§ШЗЕФЃЁ

- TypeScriptв§ШыСЫРраЭЃЌШЗБЃЮвУЧdebugЃЌаДЃЌЖСЕФЪБКђИќМгИпаЇЁЃ

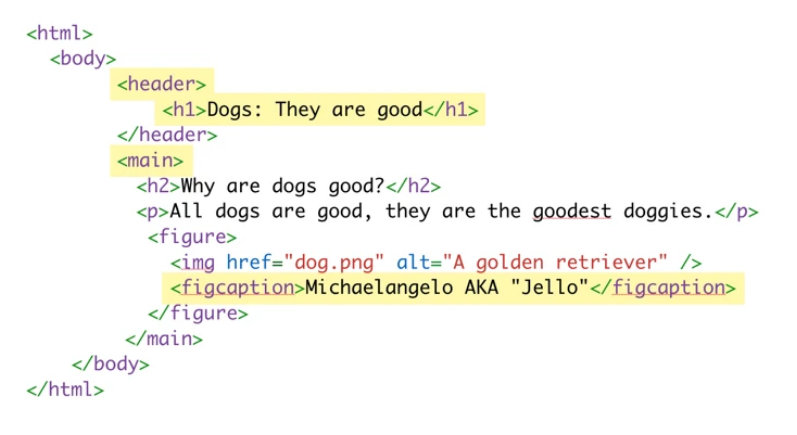

- HTMLШєЪЧЭЌбљАДееTypeScriptетбљЃЌбЯИёАДееРраЭТыБъЧЉЃЌЛсИќМгбЯИёЁЃ

- аДвЛИіБъЬтЃЌКмЖрБъЧЉЖМПЩвдЪЕЯжЃЌЕЋЪЧбЁдёheaderПЩвдИќМгзМШЗЕФДњБэЮвУЧЕФдЊЫиЃЌвВПЩвдШУДњТыПЩЖСадИќКУЁЃ

- ГфЗжРћгУКУHTMLетУЧгябдЃЌЖјВЛЪЧЕНДІЖМЪЧdivЁЃ

- НЋHTMLЕБзівЛУХгябдЃЌбЁдёзюзюКЯЪЪЕФДњТыШЅБэЯжздМКЕФФкШнЁЃ

гявхЛЏКУЕФwebгыгявхЛЏВЛКУЕФwebМфЕФЖдБШЃК

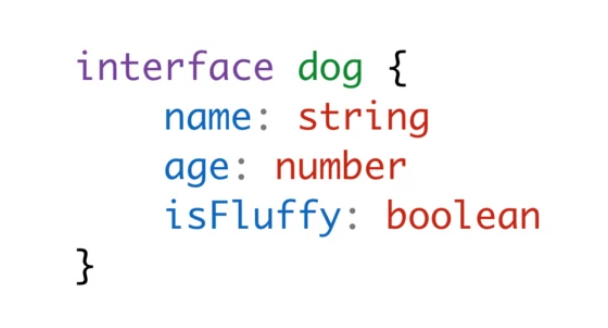

гявхЛЏКУЕФTSКЭHTMLЃК

interface dog { name: string age: number isFluffy: boolean }

гявхЛЏВЛКУЕФTSКЭHTMLЃК

interface dog { name: any age: any isFluffy: any }

ЁАЁto build for people and the long term, then simple, structural, semantic HTML was best?ЁЊ?each element deployed for itЁЏs intended purpose. DonЁЏt use a div when you mean a pЁБ?ЁЊ?Jeffery Zeldman

Get to know the HTML elements available to you, and use the appropriate one for your content. Make the most it, like you would any language you choose to code with.

Г§СЫдіЧППЩЖСадЃЌSemantic HTMLЛЙгаФФаЉЗНУцКмживЊЃП

зЪСЯСДНгЃКhttps://developer.mozilla.org...

ЯТУцетОфЛАКмживЊЃЁ

HTML should be coded to represent the data that will be populated and not based on its default presentation styling. Presentation (how it should look), is the sole responsibility of CSS.

гявхЛЏБъЧЉгаЯТУцетаЉКУДІЃК

- Search engines will consider its contents as important keywords to influence the page's search rankings (see SEO)

- Screen readers can use it as a signpost to help visually impaired users navigate a page

- Finding blocks of meaningful code is significantly easier than searching though endless divs with or without semantic or namespaced classes

- Suggests to the developer the type of data that will be populated

- Semantic naming mirrors proper custom element/component naming

УПДЮаДБъЧЉЪБЃЌЮЪздМКетбљвЛИіЮЪЬтЃК

What elements best describe/represent the data that I'm going to populate?

HTMLгявхЛЏБъЧЉВЮПМЪжВс

ЪжВсЕижЗЃКhttps://developer.mozilla.org...

НјвЛВНдіЧПWebгявхЛЏЕФWAI-ARIA

ПЩвдВщПДСэЭтвЛЦЊВЉЮФЃКЙигкWAI-ARIAФЧаЉЪТЖљ

![ДѓгябдФЃаЭЕФдЄбЕСЗ[5]ЃКгяОГбЇЯАЁЂЩЯЯТЮФбЇЯАIn-Context LearningЃКОЋЕїLLMЁЂPromptЩшМЦКЭДђЗжКЏЪ§ЃЈScoring FunctionЃЉЩшМЦвдМАICLЕзВуЛњжЦЕШдРэЯъНт](https://ucc.alicdn.com/fnj5anauszhew_20230719_fb8a261460ec4839aa48b9d34a53f4be.png?x-oss-process=image/resize,h_160,m_lfit)