ЮЪЬтвЛЃКDataWorksдДЖЫВЛжЊЕРЙ§ТЫЬѕМўеІаД ШежОРяУЛЯдЪОЙиМќаХЯЂЃП

DataWorksдДЖЫВЛжЊЕРЙ§ТЫЬѕМўеІаД ШежОРяУЛЯдЪОЙиМќаХЯЂЃП

ВЮПМЛиД№ЃК

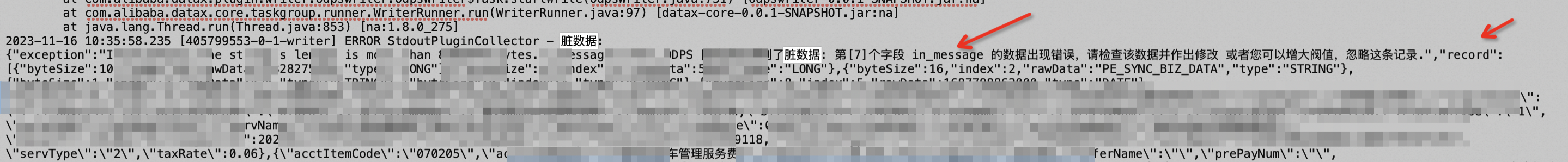

ДђгЁГіРДЕФМЧТМПЩвдЖЈЮЛЕН зжЖЮвЛАуЖМЪЧЭЌвЛИідДЖЫПДгаУЛгаВщsizeжЎРрЕФКЏЪ§

ЙигкБОЮЪЬтЕФИќЖрЛиД№ПЩЕуЛїдЮФВщПДЃК/ask/571280

ЮЪЬтЖўЃКDataWorksФГвЛЬѕОпЬхЕФдрЪ§ОнаХЯЂТя ЮвЯыШЁЪ§ОнПтПДПД ФЧИізжЖЮгаЖрГЄ ЮвПДВЛЕНЙиМќаХЯЂЃП

DataWorksФГвЛЬѕОпЬхЕФдрЪ§ОнаХЯЂТя ЮвЯыШЁЪ§ОнПтПДПД ФЧИізжЖЮгаЖрГЄ Яждк ФЧИіШежОБЛНиШЁСЫ ЮвПДВЛЕНЙиМќаХЯЂЃП

ВЮПМЛиД№ЃК

ЖдгкDataWorksжаЕФдрЪ§ОнЃЌФњПЩвдЭЈЙ§вдЯТВНжшНјааВщПДКЭЖЈЮЛЃК

- діДѓдрЪ§ОнЯожЦЬѕЪ§ЃЌРЉДѓуажЕЃЌШнШЬдрЪ§ОнЁЃдДЖЫдрЪ§ОнШдДцдкЃЌВЛЭЌВНЕНФПЕФЖЫЃЌШежОЛсЯдЪОдрЪ§ОнМЧТМЃЌШЮЮёВЛЛсБЈДэЁЃ

- ИљОндЫааШежОЖЈЮЛдДЖЫдрЪ§ОнЃЌаоИДКѓдйЭЌВНЁЃ

- ШчЙћгіЕНЬиЖЈЮЪЬтЃЌШчЪБМфИёЪНЕМжТБЈДэдрЪ§ОнЃЌашвЊИљОнБЈДэдвђЃЌЕїећЭЌВНгІШчКЮНтЮіИУЪБМфИёЪНЕФЪ§ОнЁЃ

- ФњПЩвддкЭЌВНШЮЮёХфжУЪБжИЖЈдрЪ§ОнВњЩњЬѕЪ§ЃЌПижЦЪЧЗёдЪаэдрЪ§ОнВњЩњЁЃ

ЙигкБОЮЪЬтЕФИќЖрЛиД№ПЩЕуЛїдЮФВщПДЃК/ask/571276

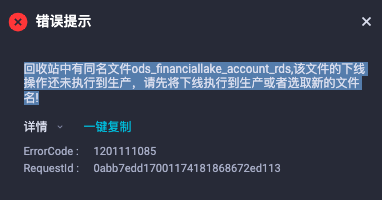

ЮЪЬтШ§ЃКDataWorksЪ§ОнДЋЪфЭъСЫ ЃЌ ПДЕНСЫдрЪ§ОнзжЖЮЃЌ етИіеІДІРэАЁЃП

DataWorksЪ§ОнДЋЪфЭъСЫ ЃЌ ПДЕНСЫдрЪ§ОнзжЖЮЃЌ дЪМЪЧ mediumtext РраЭЃЌ ЮветБпДцЕФЪЧstring РраЭ ЃЌ ИаОѕЪЧГЄЖШГЌЯо етИіеІДІРэАЁЃП

ВЮПМЛиД№ЃК

sessionМЖБ№ЩшжУset odps.sql.cfiles.field.maxsize=16384ЃЌФЌШЯ8mВЛНЈвщЩшжУЬЋДѓЃЌЛсЕМжТФкДцвчГіЁЃ

setproject odps.sql.cfile2.field.maxsize=16384; етИіflagЪЧгУРДЯюФПМЖБ№ЯожЦУПСазжЗћДЎРраЭзюДѓФмаДШыЕФГЄЖШЃЌЕЅЮЛЮЊKBЃЌФЌШЯ8192ЃЈвВОЭЪЧ8MЃЉЃЌзюДѓжЕ262144ЁЃашвЊЫЕУїЕФЪЧЃЌString sizeдкМЋЖЫБШНЯДѓЕФГЁОАЯТЃЌЛсгаOOMЮЪЬтЕФЗчЯеЃЌЫљвдЪЧВЛНЈвщЩшжУБШНЯДѓЕФжЕЃЌФПЧАЩшжУЕН16384ЃЌЪЧЯрЖдПЩПиЕФЃЌМЏГЩШЮЮё гІИУжЛФмЯюФПМЖБ№ЩшжУ

ЙигкБОЮЪЬтЕФИќЖрЛиД№ПЩЕуЛїдЮФВщПДЃК/ask/571272

ЮЪЬтЫФЃКDataWorksНЋЯТЯпШЮЮёжиНЈКѓБЈДэЕЋЪЧдкЗЂВМСаБэжавбОЯТЯпГЩЙІСЫЃП

DataWorksНЋЯТЯпШЮЮёжиНЈКѓБЈДэЕЋЪЧдкЗЂВМСаБэжавбОЯТЯпГЩЙІСЫЃП

ВЮПМЛиД№ЃК

ШчЙћФњдк DataWorks жаЩОГ§НкЕуВЂНЋИУНкЕуЗЂВМЕНЩњВњЛЗОГжЎКѓЗЂЯжжиНЈШЮЮёЪББЈДэЃЌЕЋдкЗЂВМСаБэжаПДЕНЯТЯпГЩЙІЕФзДЬЌЃЌЧыМьВщвдЯТМИЕуЃК

- ЩОГ§НкЕуВйзїЪЧЗёвбОЭъШЋжДааЭъБЯЃКдк DataWorks жаЩОГ§НкЕуЪЧвЛИівьВНЙ§ГЬЃЌвђДЫФњашвЊШЗБЃЩОГ§ВйзївбЭъГЩКѓдйГЂЪджиНЈШЮЮёЃЛ

- ШЗШЯЯТЯпНкЕуЕФзДЬЌЃКФњПЩвддк DataWorks ПижЦЬЈжаВщПДЯТЯпНкЕуЕФзДЬЌЃЌШЗШЯЫќвбОБЛЯТЯпЃЛ

- МьВщвРРЕЙиЯЕЃКШчЙћФњдкжиНЈШЮЮёЙ§ГЬжажИЖЈСЫДэЮѓЕФвРРЕЙиЯЕЃЌвВПЩФмЕМжТШЮЮёЪЇАмЁЃЧыМьВщФњЫљжИЖЈЕФвРРЕЙиЯЕЪЧЗёе§ШЗЃЛ

ЙигкБОЮЪЬтЕФИќЖрЛиД№ПЩЕуЛїдЮФВщПДЃК/ask/571267

ЮЪЬтЮхЃКDataWorksетИіБЈДэЃЌЧыЮЪдѕУДНтОіЃП

DataWorksетИіБЈДэЃЌЧыЮЪдѕУДНтОіЃПfailed: ERROR: Total memory used by all existing queries exceeded memory limitation. Detail: current total memory limit: 35398159794, current total memory usage: 35375693209, resource group name: default

ВЮПМЛиД№ЃК

етИіБЈДэЪЧгЩгкDataWorksжаЫљгаЯжгаВщбЏЪЙгУЕФзмФкДцГЌЙ§СЫФкДцЯожЦЁЃвЊНтОіетИіЮЪЬтЃЌПЩвдГЂЪдвдЯТЗНЗЈЃК

- діМгФкДцЯожЦЃКПЩвдЭЈЙ§аоИФDataWorksЕФХфжУЮФМўРДдіМгФкДцЯожЦЁЃОпЬхВйзїЗНЗЈПЩвдВЮПМЙйЗНЮФЕЕЁЃ

- гХЛЏВщбЏгяОфЃКМьВщDataWorksжаЕФВщбЏгяОфЃЌОЁСПМѕЩйФкДцЯћКФЕФВйзїЃЌР§ШчБмУтЪЙгУзгВщбЏЁЂСйЪББэЕШЁЃ

- ЗжХњДІРэЪ§ОнЃКШчЙћЪ§ОнСПНЯДѓЃЌПЩвдПМТЧНЋЪ§ОнЗжХњДІРэЃЌУПДЮДІРэвЛВПЗжЪ§ОнЃЌвдМѕЩйЕЅДЮВщбЏЫљашЕФФкДцЁЃ

- ЙиБеВЛБивЊЕФВщбЏЃКМьВщDataWorksжаЕФВщбЏЃЌЙиБевЛаЉВЛБивЊЕФВщбЏЃЌвдЪЭЗХФкДцзЪдДЁЃ

ЙигкБОЮЪЬтЕФИќЖрЛиД№ПЩЕуЛїдЮФВщПДЃК/ask/571261