вЛЁЂБГОА

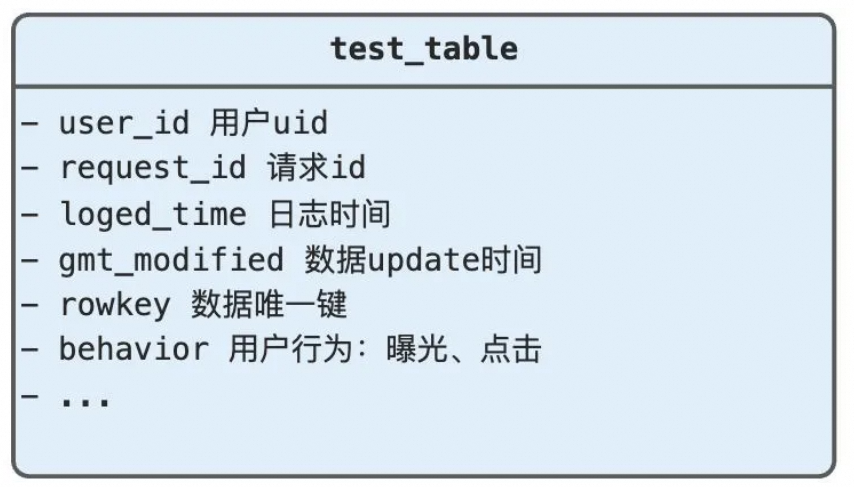

зюНќдкбаЗЂЪЕЪБЪ§ОнЕФЙ§ГЬжаХіЕНСЫашвЊupdateаДШыExploreЕФДѓЛљЪ§ЪЕЪБЪ§ОнБэЕФГЁОАЁЃЮЊСЫжЇГжжЇИЖБІФГИіЙуИцЮЛЕФЪЕЪБПДЪ§ашЧѓЃЌашвЊМЦЫуЪЕЪБРлМЦЕФСїСПаЇЙћЪ§ОнЁЃБШШчЦиЙтpvЁЂЕуЛїpvЃЌЦиЙтuvЁЂЕуЛїuvЃЌpvЦиЙтЕуЛїТЪЁЃ

- зЂЃКExplorerЪЧвЛПюТьвЯздбаКЃСПЪ§ОнЙцФЃЯТЕЭбгЪБЯьгІЕФЪЕЪБЗжЮіаЭ(OLAP)Ъ§ОнПт, ФПБъЪЧЬсЙЉОлКЯВщбЏФмСІКЭвЛаЉИпНзЗжЮіЙІФмЁЃЖдБъвЕНчClickHouseКЭАЂРяЕФдЦдЩњЪ§ОнВжПтAnalyticDBЁЃ

ЯжИљОнвЕЮёашЧѓЃЌашвЊНЋгУЛЇЖрДЮааЮЊМЧТМАДЬиЖЈШЅжиЙцдђКЯВЂГЩ1ЬѕМЦЫуЁЃвђДЫЩшМЦСЫвЛеХдкuser_idЁЂrequest_idСЃЖШЩЯЕФДѓЛљЪ§explorerБэЃЌФПБъаДШыЪ§ОнСПдк50ЁЋ80Эђаа/minзѓгвЁЃЯЃЭћФмдкДЫЛљДЁЩЯМЦЫуГізМШЗЕФЪЕЪБРлМЦЦиЙтpvЪ§ОнЁЃ

BlinkШЮЮёЩЯЯпКѓЃЌsinkНкЕуЪ§ОнаДШыСПдк30wаа/minвдЩЯЪБЛсГжајБЈДэexplorerСДНгЪЇАмЃЌШЮЮёЦЕЗБЪЇАмжиЦєЃЌЕМжТбгГйГжајЩЯеЧЁЃБОЮФзмНсСЫГЃгУЕФгХЛЏЫМТЗКЭВйзїЃЌЙЉВЮПМЁЃ

com.alibaba.blink.streaming.connectors.common.exception.BlinkRuntimeException: ************ ERR_ID: CON-02010602 CAUSE: Explorer operation failed, msg: Cannot get a connection, pool error Timeout waiting for idle object ACTION: Flush to explorer table failed, contact blink/explorer admin for help. DETAIL: ************

explorerБэР§згЃК

ЖўЁЂЮЪЬтГіЯжЕФжБНгдвђ

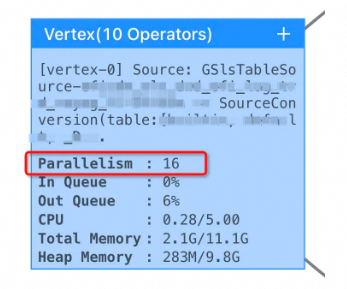

жБНгдвђЪЧexplorerМЏШКжаИКдиВЛОљдШЁЃВПЗжЛњЦїИКдиЙ§ИпЃЌДѓХњСПаДШыЕФЪБКђcpuЪЙгУТЪКмИпЕМжТаДШыЯьгІТ§ЃЌзюжедьГЩаДШыГЌЪББЈДэЃЌBlinkШЮЮёЪЇАмжиЦєЁЃБШШчЃЌexplorerБэХфжУЕФshardЪ§ЪЧ10ЃЈhashBucketЃЉ * 2ЃЈshardConfig_task_replicantsЃЉ = 20ЃЌМйШчexplorerМЏШКЕФЛњЦїжЛга14ЬЈЃЌРэТлЩЯНВЛсга6ЬЈЛњЦїЕФИКдиБШЦфЫћЛњЦїИпЃЌДѓХњСПаДЕФЪБКђcpuЪЙгУТЪЛсКмИпЃЌаДШыЯьгІТ§ЃЌ ЕМжТBlinkаДШыГЌЪББЈДэЃЌШЮЮёЪЇАмжиЦєЁЃ

Ш§ЁЂгХЛЏЫМТЗ

3.1. ОљдШЛњЦїИКдиЃКЭЈЙ§гХЛЏexplorerБэЗжЦЌЪ§

- БэЕФЗжЦЌЪ§ашвЊИљОнМЏШКгаЖрЩйЛњЦїНјааЕїећЁЃБШШчМЏШКЛњЦїга14ЬЈЃЌПЩвдЭЈЙ§ЩшжУhash_bucket=14ЃЌШУСДНгЖМОљдШЕФЗжВМдк14ЬЈЛњЦїЩЯ, ВЛШУВПЗжЛњЦїИКдиЙ§ИпЁЃ

{ "shardConfig_partition_columns": "test_column", // ИљОнИУСаНјааЙўЯЃдЫЫу "hash_bucket": "14", // ЙўЯЃЗжЭАИіЪ§ "update_model": "Row", // ИќаТФЃЪНЃКзЗМгаДШы/ИВИЧаДШы "shardConfig_task_replicants": "2", -- ИББОЪ§СП "storage_engine": "test_engine", "storage_explorer_tier": "test", }

3.2. ЕїДѓГЌЪБЪБМфХфжУ

ЃЈзюМђЕЅДжБЉЕФЗНЪНЃЌВЛФмДгБОжЪЩЯНтОіЮЪЬтЃЉ

blinkЪЧЭЈЙ§jdbcСДНгЕФexplorerЃЌДДНЈexplorerНсЙћБэЪОР§ШчЯТЃК

create table explorer_output( user_id varchar, request_id varchar, ..., primary key(rowkey) ) WITH ( -- аДШыexplorerЪБЕФИїжжВЮЪ§ХфжУ `user`='test_name' ,`url`='jdbc:mysql:///${test_ip}/cheetah?characterEncoding=utf8&autoReconnect=true&connectTimeout=10000&socketTimeout=30000&rewriteBatchedStatements=true'' ,`zdalpassword`='${test_password}' ,`tablename`='test_table' ,`type`='explorer' ,`cache`='ALL' ,`batchInsertSize`='20000' ,`partitionBy`='rowkey' )

ГЌЪБХфжУзЂвтЪТЯюЃК

- blinkСДНгexplorerЕФГЌЪБЪБМфгЩurlжаconnectTimeoutКЭsocketTimeoutХфжУЁЃconnectTimeout ЪЧblinkгыexplorer TCPНЈСЊЕФГЌЪБЪБМфЃЌsocketTimeoutЪЧblinkЕНexplorer TCPЖСаДЪ§ОнЕФГЌЪБЪБМфЁЃ

ОГЂЪдЃЌЪЕМЪНЋsocketTimeOutЪЪЕБЕїДѓКѓЃЌБЈДэЕФЦЕТЪЛсМѕЩйвЛаЉЁЃ

3.3. МѕЩйаДШыЪ§ОнСП

3.3.1. Blink sqlТпМгХЛЏЃКЭЈЙ§ШЅжиМѕЩйЪфГіЕНsinkЫузгЕФСП

- ЁОЗНЗЈ1ЁПhaving countЃЈ*ЃЉ = 1ЃЌ ЪЙЕУЭЌЮЌЖШЯТгаЖрЬѕЪ§ОнЪБЃЌжЛШЁЕквЛЬѕЁЃаЇЙћРрЫЦfirst_value() OVER partion by xxx order byДАПкКЏЪ§ЁЃЕЋЪЧОЪЕВтКѓЗЂЯжгаЮЪЬтЃЌЛсЖЊЪЇЪ§ОнЁЃЛГвЩЪЧПЊСЫminiBatchЮЂХњДІРэКѓЕквЛДЮcountОЭГЌЙ§1ЃЌЪ§ОнБЛЙ§ТЫЕєСЫЁЃ

SELECT `user_id`, `request_id`, ... FROM `expo_detail` WHERE `request_id` IS NOT NULL GROUP BY `user_id`, `request_id`, ... having count(*) = 1

- ЁОЗНЗЈ2ЁПКѓајИФГЩrow_number ЗНАИЃЌЯрЭЌЮЌЖШИљОнШежОЪБМфХХађШЁЕквЛЬѕМЧТММДПЩЃЌЪОР§ДњТыШчЯТЃК

SELECT `user_id`, `behavior`, `request_id`, ... ROW_NUMBER() OVER ( PARTITION BY `behavior`, `request_id`, ... ORDER BY loged_time -- ЫГађХХОЭаа ) AS rn FROM ( SELECT `user_id`, `behavior`, `request_id`, ... FROM `expo_detail` WHERE `request_id` IS NOT NULL ) ) WHERE rn <= 1 -- жЛШЁЕквЛЬѕМЧТМЃЌВЛЖЊЪЇМДПЩ

3.3.2. Blink sqlТпМгХЛЏЃКЙ§ТЫШпгрЪ§ОнВЛВЮгыМЦЫу

- дкЖСШЁЩЯгЮЪ§ОнЪБПЩвдОЁСПЙ§ТЫЕєШпгрЪ§ОнЃЌВЛВЮгыКѓајЫузгЕФМЦЫуЁЃ

- БОАИР§жаЕФШежОЪБМфгаСНИіЃЌПЭЛЇЖЫЪТЪЕЗЂЩњЕФШежОЪБМфКЭЗўЮёЖЫЩЯБЈЕФШежОЪБМфЁЃ

- ПЭЛЇЖЫШежОЪБМфЛсДцдкТвађЕФЧщПіЃЈБШШчМИЬьЧАЕФЪ§ОнбгГйЕНДяЁЂгЩгкЪБЧјВЛЭЌЕМжТЕФЁАЮДРДЁБЕФЪБМфЃЉЁЃЭЈЙ§ЯожЦlog_timeЃЈПЭЛЇЖЫШежОЪБМфЃЉдкЕБЬьФкЧв<=ЕБЧАзюаТЪБМфЃЌПЩвдЙ§ТЫЕєВЛашвЊЕФЪ§ОнЃЌМѕЩйвЛЖЈЪ§ОнСПЁЃ

- loged_timeЗўЮёЖЫЩЯБЈЪБМфЯрБШПЭЛЇЖЫШежОЪБМфЃЌТвађЕФЧщПіЛсЩйвЛаЉЁЃДЫДІгЩгквЕЮёашвЊЃЌвдПЭЛЇЖЫШежОЪБМфЮЊзМЁЃ

3.3.3. BlinkВЮЪ§гХЛЏЃКЯожЦЖСШЁШежОСїЕФtps

- ПЩЭЈЙ§ЯожЦЩЯгЮЪфШыЕФtpsЃЌШУЪ§ОнЮШЖЈПьЫйЕФБЛДІРэЭъЪфГіГіШЅЁЃ

- ШчЙћЩшжУЙ§ДѓЃЌдкtpsИпЗхГіЯжЪБЃЌsourceНкЕуЪфШыtpsСПЛсБЉеЧЃЌИјШЮЮёДјРДНЯДѓЕФадФмбЙСІЃЌзюжевВЛсгАЯьsinkНкЕуаДШыexplorerЕФЮШЖЈадЁЃ

CREATE TABLE test_table ( .... ) WITH ( -- blinkВЮЪ§ХфжУ `batchGetSize`='5', -- ЪЪЕБЕїаЁЃЌЛКНтtpsИпЗхЪБДјРДЕФадФмбЙСІ ... );

3.3.4. BlinkжДааМЦЛЎгХЛЏЃКМѕЩйsourceНкЕуВЂЗЂ

- ПЩвдЭЈЙ§МѕЩйsourceНкЕуЕФВЂЗЂЃЌМѕЩйЯТгЮЫузгбЙСІ

- ШчЭМЃЌПЩвддкFlink UIНчУцЩЯВщПДsourceНкЕуЕФВЂЗЂЪ§ЁЃвЛАуsourceНкЕуЕФВЂЗЂКЭЩЯгЮЗжЦЌЪ§БЃГжвЛжТЁЃЪЪЕБЕїаЁвВПЩвдМѕЩйЯТгЮаДШыбЙСІЁЃ

3.4. ЦфЫћГЃМћбгГйЕїгХЗНЗЈ

3.4.1. BlinkВЮЪ§гХЛЏЃКЕїећexplorerаДШыВЮЪ§

ПЩвдИФХфжУПижЦBlinkаДШыexplorerЕФЦЕТЪКЭвЛДЮаДШыЕФЪ§ОнСПЃЌЬсИпаДШыЕФаЇТЪЁЃExplorerаДШыBlinkВЮЪ§ХфжУЫЕУїЃК

| ВЮЪ§ | зЂЪЭЫЕУї | БИзЂ |

| batchInsertSize | вЛДЮаДШыЕФЬѕЪ§ | ПЩбЁЃЌФЌШЯ200 |

| flushPoolSize | аДШыЯпГЬЪ§ | ПЩбЁЃЌФЌШЯ1ЃЌГЌЙ§1ЃЌаДЪ§ОнЛсТвађ, ШчЙћЪЧupdateБэВЛФмПЊЦє |

| workQueueSize | executorЕФЙЄзїЖгСаДѓаЁЃЌКЭbufferДѓаЁГЩе§БШЃЌЕїДѓОЭдЪаэИќЖрЪ§ОндкЛКДцжа | ПЩбЁЃЌФЌШЯЪЧ20 |

| flushIntervalMs | ЫЂЪ§ОнжмЦкЃЌаДШыЫйЖШ 1ДЮ/2sЃЌ30ДЮ/m | ФЌШЯ2sЃЌБэЪОУП2sЛсЫЂвЛДЮЪ§Он |

CREATE TABLE test_table ( `user_id` VARCHAR, `rowkey` VARCHAR, `loged_time` TIMESTAMP, ... primary key(`user_id`, `rowkey`) ) WITH ( -- ВПЗжВЮЪ§ЪОР§ `tablename`='test_table' ,`type`='explorer' ,`cache`='ALL' ,`batchInsertSize`='500' -- вЛДЮаДШыЕФЬѕЪ§ ФЌШЯ200 ,`partitionBy`='rowkey' ,`workeQueueSize`='50' -- executorЕФЙЄзїЖгСаДѓаЁЃЌФЌШЯ20 ,`flushIntervalMs`='2000' -- ЫЂЪ§ОнжмЦкЃЌФЌШЯ2sЃЌУП2sЫЂвЛДЮЪ§Он );

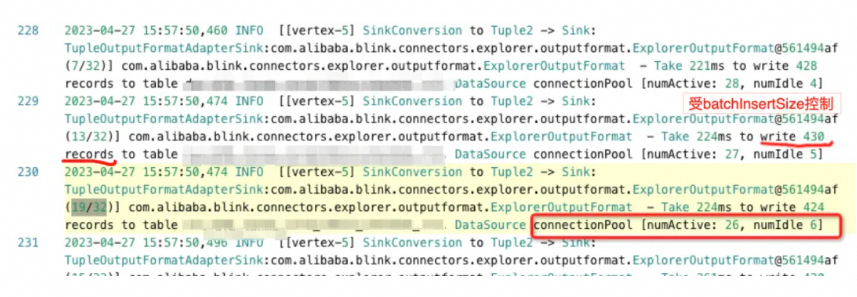

ВЙГфЃКTaskManager/subTask/slotКЭЯпГЬГи/ЯпГЬКЭinsertBatchSizeЕФЙиЯЕ

вЛИіslotЖдгІвЛИіsubTaskЃЌвЛИіtaskManagerМйЩшга32ИіslotЃЌга32ИіsubTaskЃЌ ФЧУДвЛИіsubTaskЖдгІвЛИіЯпГЬЁЃећИіconnectionPoolЙВ32ИіЯпГЬЃЌЛсЭЌЪБгаЛюдОКЭЗЧЛюдОЕФЯпГЬЁЃSinkНкЕуВЂЗЂЪ§КЭcpuЪ§ЛсгАЯьsubTaskЕФИіЪ§ЁЃДДНЈexplorerНсЙћБэЕФХфжУinsertBatchSizeЛсгАЯьвЛДЮаДШыЕФЪ§ОнСПЁЃflushIntervalгАЯьаДШыЕФЦЕТЪЁЃupdateБэвЛДЮаДШыЕФЪ§ОнСПдіМгЃЌКФЪБЛсдіДѓЁЃ

3.4.2. БмУтЦЕЗБFull GC

РЌЛјЛиЪеЦкМфЃЌШЮЮёЛсжаЖЯжДааЃЌгАЯьBlinkадФмЁЃШчКЮЗЂЯжFull GCЃКЭЈЙ§МрПиFlink metricsПЩвджБНгЗЂЯжЁЃ

вВПЩвддкFlink UIНчУцЩЯЕуЛїФГвЛИіtaskManagerЃЌЕуЛїMetricВщПДOld Generation GCДЮЪ§ЃЌЬЋДѓЫЕУїДцдкЦЕЗБGCЕФЧщПіЃЌИУtaskManagerЕФheapФкДцВЛЙЛЁЃ

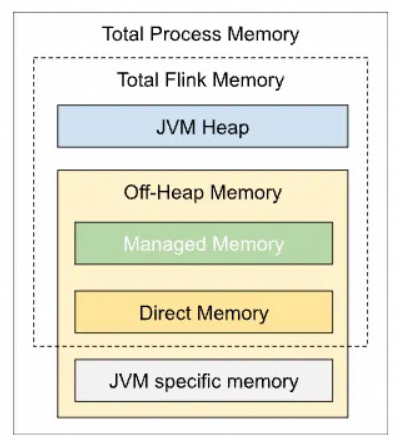

дѕУДХаЖЯФкДцВЛЙЛЃПвЛАуашвЊЛКДцДѓСПЕФЪ§ОнЕФЕиЗНОЭашвЊЕїДѓTask Off-HeapЖбФкДцЁЃБШШчзіПЊДАМЦЫуЪБЃЌашвЊЛКДцwindowДАПкЖЮФкЕФЪ§ОнЁЃВЙГфЃК

FlinkФкДцФЃаЭЃКhttps://nightlies.apache.org/flink/flink-docs-release-1.14/zh/docs/deployment/memory/mem_setup_tm/

3.4.3. ЦфЫћФкДцдѕУДЕї

- native ФкДцЃКПЊДАМЦЫуЃЌОлКЯМЦЫу, ЮЌБэЙиСЊЃЌШЅжиЃЌетаЉВйзїашвЊЕїДѓnative ФкДцЁЃ

- Direct memoryЃКЕБГіЯжDirectBuffer ФкДцвчГіЃЈOut Of MemoryЃЉБЈДэЪБЪБЃЌПЩЭЈЙ§аоИФblinkШЮЮёВЮЪ§ЕїДѓDirect memoryЁЃ

- ВЮПМЃКhttps://nightlies.apache.org/flink/flink-docs-release-1.13/zh/docs/deployment/memory/mem_setup_tm/

ЫФЁЂзмНс

ОЙ§вдЩЯЗНЪНЕїгХКѓЃЌдкСїСПе§ГЃЕФЧщПіЯТЃЌШЮЮёВЛдйГіЯжexplorerСДНгЪЇАмБЈДэКЭбгГйЃЌаДШыexplorerБэЕФЪ§ОнСПЮШЖЈдк60-80wаа/minЁЃ

ЕЋДгНтОіжИБъШЅжиЕФвЕЮёЮЪЬтЕФНЧЖШРДНВЃЌЭЈЙ§ДцuidЁЂrequest_idМЖУїЯИЪ§ОнЕФЗНЪНМЦЫуЪЕЪБРлМЦЦиЙтpvдкетИіГЁОАЯТВЂВЛЪЧвЛИізюКУЕФЗНАИЁЃ

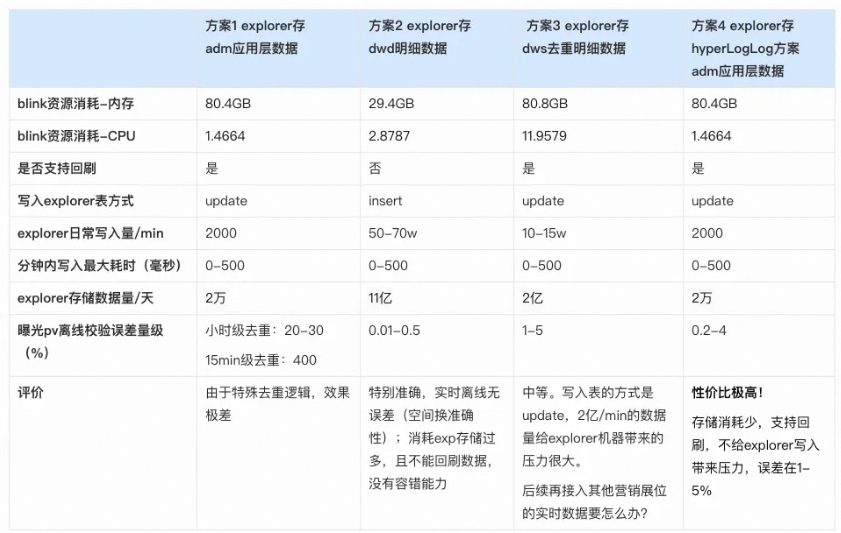

ЛЛИіЫМТЗЃЌИУвГУцЧјПщЕФЦиЙтpvашвЊдкuidЁЂrequest_idМЖБ№ЩЯШЅжиЃЌПДЦ№РДЪЧвЛИіЖрЮЌЖШШЅжиЕФЮЪЬтЃЌЕЋЪЕМЪЩЯuidКЭrequest_idЪЧ1ЖдЖрЕФЙиЯЕЃЌВЛЪЧЖрЖдЖрЃЌЖдгкУПвЛИіuidЃЌвЛИіrequest_idЯТЕФЖрДЮЦиЙташвЊШЅжиЃЌПЩвдзЊЛЏЮЊжБНгЖдrequest_idШЅжиЁЃМЦЫуuvЪЧЕЅЮЌЖШШЅжиЮЪЬтЕФЕфаЭР§згЃЌВЮПМГЃМћЕФuvШЅжиЕФЗНЪНЃЌПЩвдВЩгУСЫhyperLogLogЫуЗЈЃЈдРэМћВЮПМЮФЯз3ЃЉМЦЫуЦиЙтpvЪ§ОнЁЃДЫДІдйИНвЛИіМИжжШЅжиЗНАИЕФадФмЖдБШЪ§ОнЃЌПЩвдПДГіЗНАИ4 explorerДцДЂ15minМЖЗжЪБadmЪ§Он+hyperLogLogЫуЗЈМЦЫуШЅжиЦиЙтpvБШНЯКУЃЈЧАЬсЪЧвЕЮёПДЪ§ПЩвдНгЪм1-5%гЩhyperLogLogДјРДЕФЮѓВюЃЉЁЃ

ВЮПМЮФЕЕ/ЮФЯз

- FlinkЙйЗНЮФЕЕЃКhttps://nightlies.apache.org/flink/flink-docs-master/zh/docs/concepts/flink-architecture/

- АЂРядЦ-ЪЕЪБМЦЫуBlinkгУЛЇЮФЕЕЃК https://help.aliyun.com/apsara/enterprise/v_3_15_0_20210816/sc/enterprise-user-guide/what-is-realtime-compute1.html?spm=a2c4g.14484438.10001.25

- Flajolet, P., Fusy, ?., Gandouet, O., & Meunier, F. (2007). Hyperloglog: the analysis of a near-optimal cardinality estimation algorithm. Discrete mathematics & theoretical computer science, (Proceedings).

зїеп | ЛГZ

РДдД | АЂРядЦПЊЗЂепЙЋжкКХ